[DreamBooth 모델]

CVPR2023에서도 Best Paper를 거머쥔 주제가 DreamBooth 관련 논문이었을 정도로 AI 신기술이라고 할 수 있다.

이전에 이와 유사한 생성형 AI로 유행을 이끌었던 SNOW사의 AI프로필도 이와 비슷한 작업이라고 할 수있다.

즉, 내가 원하는 train dataset으로 target 객체를 diffusion 모델에 올릴 수 있는 방법을 배우게 된다.

왼쪽은 실제 개발자가 20~30장 정도의 학습시킬 target image를 선별한 것이다. 최대한 배경이 적은 이미지를 모을 수록 양질의 결과물을 가질 수 있다. 다양한 각도, 모습을 가진 사진일 수록 좋다.

모델 선택에서는 내가 학습시키는 이미지들이 2D인지 animation 스타일인지, 실사 스타일인지에 따라서 우리가 갖고 있는 checkpoint 중 일치하는 스타일로 학습시킬 수록 더 좋다고 한다.

Model : 내가 완성할 모델의 이름을 알아볼 수 있도록 적으면 된다.

Epochs : 적은 데이터 -> 100, 많은 데이터 -> 200 이상 ; 실험적으로 조정해봐야 한다.

Max Resolution : 최소 512로 두고 한다.

Optimizer : 8bit AdamW

Mixed Precision : fp16 (bf16이 성능은 좋지만 메모리를 많이 씀)

[Concept]

Directory : 미리 구축한 dataset dir (객체가 많이 나온 사진은 오히려 삭제하면 좋다.)

Instance Token(Prompt) : 내가 학습시키고자 하는 객체 (a photo of kongki)

Class Token(Prompt) : 일반적인 객체 (dog)

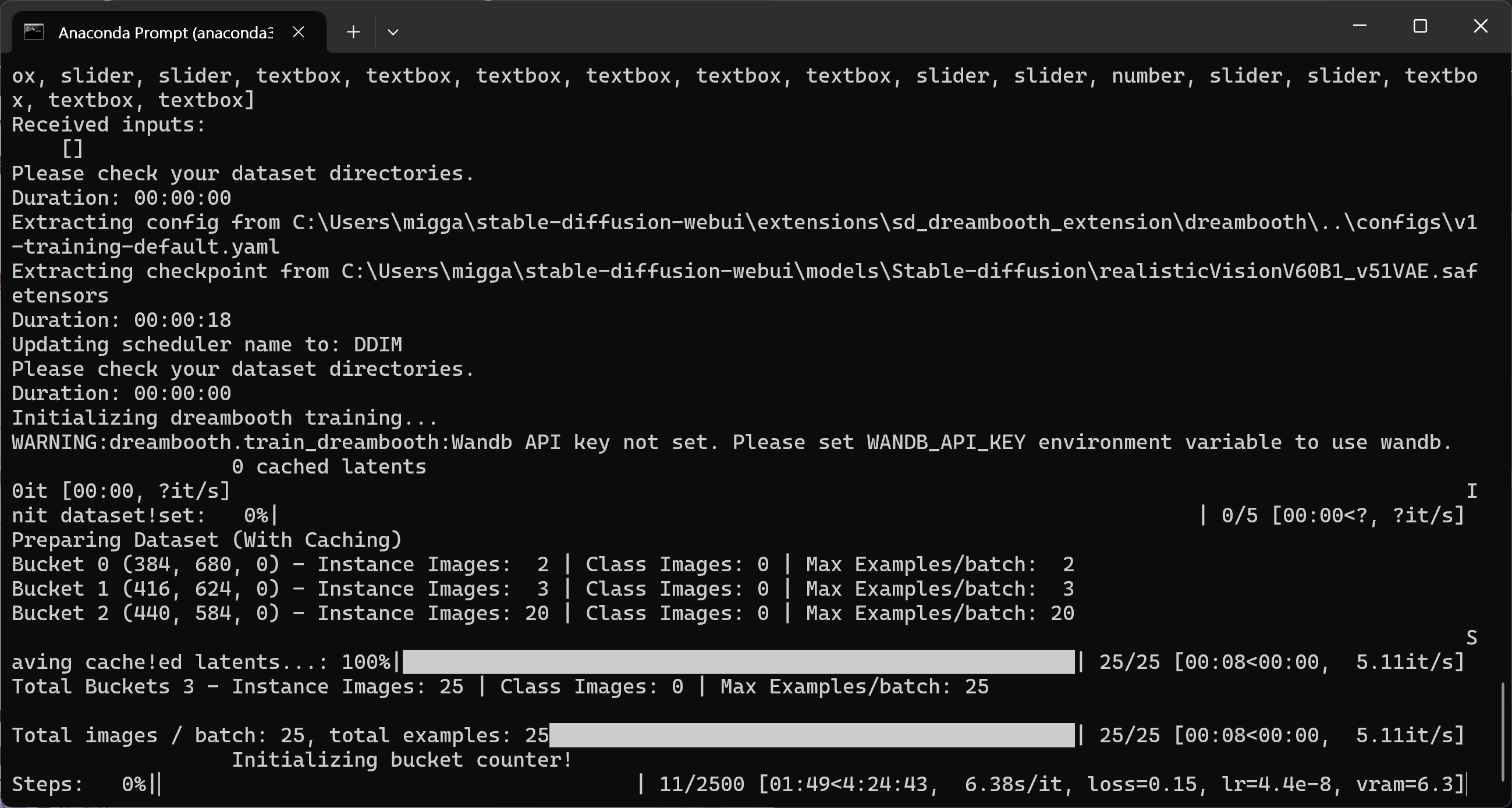

Make model하기

결과 화면

'배우기 > AI prompt 배우기' 카테고리의 다른 글

| [AI 프롬프트] 메타코드 강의 7일차_동영상 생성하기2 (0) | 2024.03.28 |

|---|---|

| [AI 프롬프트] 메타코드 강의 6일차_동영상 생성하기 (0) | 2024.03.27 |

| [AI 프롬프트] 메타코드 강의 4일차_Image to Image, Inpaint (0) | 2024.03.24 |

| [AI 프롬프트] 메타코드 강의 3일차_Stable Diffusion 실습 (1) | 2024.03.23 |

| [AI 프롬프트] 메타코드 강의 2일차_Stable_Diffusion 설치 및 활용 (0) | 2024.03.21 |